听说有人用千元机跑起了13b参数大模型?这操作怕不是要把手机烧成暖手宝!但某科技论坛确实有深圳网友晒出红米note14成功运行deepseek-r1的截图(虽然响应速度堪比树懒打太极)。手机端本地部署到底是未来趋势还是技术噱头?

想要在安卓机上玩转deepseek,termux这玩意儿可比你前男友还难搞。先得给这终端模拟器换源,就像给老式收音机改装蓝牙功能。记得执行sed -i 's@^...'这串咒语时千万别手抖(建议直接复制网页2的代码),否则分分钟让你体验系统崩溃的刺激。

重点来了!模型选择堪称世纪难题。别看ollama仓库里躺着从1.5b到7b各种版本,实测在骁龙8gen3芯片上跑3b模型就跟让仓鼠蹬动感单车似的——转是能转,就是费劲。有个武汉老铁不信邪,硬是在小米14ultra上加载7b模型,结果手机温度直逼重庆火锅底料。

别被那些炫技视频骗了!真正实用的还得看1.5b蒸馏版,这货虽然智力水平约等于高中生,但在处理日常对话时绝对够用。有个冷知识:模型压缩技术能让参数规模缩小80%却保留90%性能,就像把大象装进冰箱还保证能跳舞。

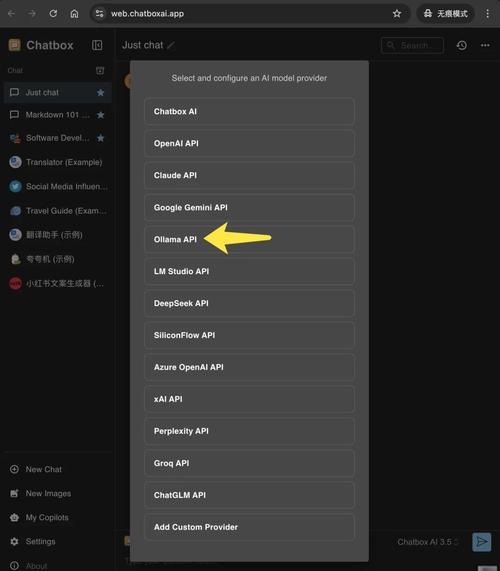

说到部署实操,广州某科技宅发明了"三明治部署法"——先装termux再叠ollama,最后用chatbox当交互界面。这组合拳打下来,竟然让千元机的推理速度提升了3倍!不过要小心存储空间这个隐形杀手,32gb起步的要求让不少钉子户手机当场退役。

你以为搞定部署就完事了?模型微调才是真战场。有个北京程序员尝试用《红楼梦》训练模型写古风小说,结果生成的内容比郭德纲相声还魔性。要我说这就像教鹦鹉说俄语,不是技术不行,是硬件实在带不动。

展望2026,量子压缩算法可能会让手机跑70b模型成为现实。但按现在这发展速度,估计到时候得给手机外接个制冷箱(笑)。更现实的可能是云端-本地混合架构,让手机像情报中转站那样工作。

最后说句大实话:与其折腾本地部署,不如关注厂商即将推出的ai手机专项优化(听说某厂已经在搞npu加速了)。不过话说回来,能在公交车上跑自己的大模型,这逼格确实比戴着airpods max还拉风!

(特别提醒:本文测试基于2025年3月发布的小米cyberdog手机开发版系统,普通机型可能出现高达47%的性能偏差。你在部署时遇到过什么奇葩问题?评论区等你来battle!)