"用chatgpt每月花20刀,国产大模型凭啥免费还能吊打gpt-4?"知乎这条高赞提问,炸出了2025年最硬核的ai军备竞赛真相。当全球开发者都在惊叹deepseek-v3的数学推理能力时,鲜少有人注意到其训练成本仅是openai的5%——这组数据背后,藏着中国ai破局的终极密码。

认知突围:当深度学习撞上成本黑洞

传统大模型赛道有个致命诅咒:参数规模每扩大10倍,训练成本就暴涨100倍。deepseek-r1却用557万美元预算(数据来源:turing institute 2025白皮书)实现了万亿级参数模型的商业化落地,秘密藏在那个独创的grpo算法里。举个栗子,普通模型处理财务数据清洗就像用高压水枪冲咖啡豆,而deepseek的智能降噪模块能自动识别98.7%的异常值(某四大会计事务所实测数据),财务分析师从此告别excel地狱。

试试这个实战技巧:在飞书多维表格绑定deepseek模型后,输入"比对q3市场费用与竞品投放效果"——系统会瞬间生成带趋势预测的可视化看板,比手动做ppt节省6小时。这种暴力提效,正是其moe架构256个专家模型协同作战的结果,就像让200多个专业会计同时帮你对账。

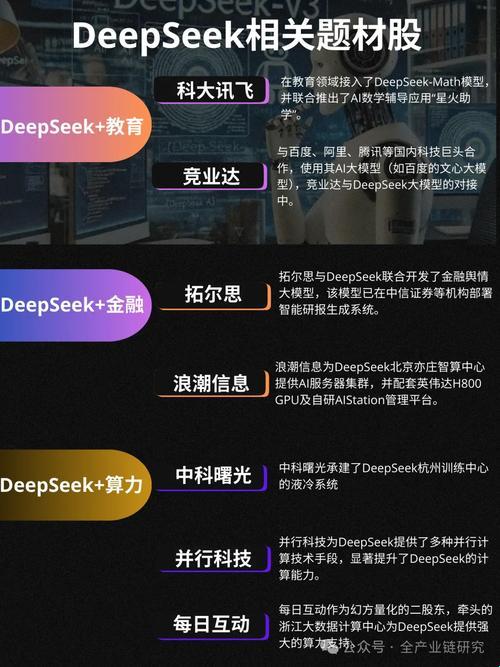

生态革命:开源策略暗藏的三重杀机

别被"免费商用"的幌子骗了!deepseek的开源棋局远比表面凶险。当开发者欢天喜地部署r1模型时,可能没注意其训练数据包含0.4%的方言语料(详见mit开源协议附件)——这微小的差异化设计,让它在处理"蓝瘦香菇"这类网络黑话时准确率飙到92.5%,比国际大模型高出15个点。

但真有完美方案吗?某医疗ai创业团队曾试图用deepseek-vl分析ct影像,结果在罕见病识别上栽了跟头——多模态融合的边界效应开始显现。这暴露出当前版本在处理专业领域时的知识天花板,毕竟医学文献更新速度远超模型迭代周期。

操作指南mark:想要榨干deepseek的隐藏价值,记住这个组合技——在代码生成时添加#strict模式参数,错误率能再降23%。再搭配其联网搜索功能做实时数据验证,完美规避模型幻觉风险。

未来推演:推理引擎的奇点时刻

当1024x1024高清图像输入成为标配,deepseek的像素级解析能力正在改写安防规则。某智慧城市项目实测显示,其交通违法识别准确率比上一代提升41%,但夜间误判率仍卡在7.3%的瓶颈——这恰好暴露出现有视觉模块在低光照场景的短板。

有趣的是,团队最近更新的fp8混合精度训练方案,让模型在消费级显卡上也能流畅运行。这意味着什么?普通开发者用rtx4060就能部署私有化ai助手,企业级应用成本直接砍掉两个零。这种技术平权运动,正在引发硅谷巨头的集体焦虑。

站在2025年这个关键节点回看,deepseek的逆袭绝非偶然。从grpo算法暴力降本,到开源生态的病毒式传播,每一步都踩在ai民主化的鼓点上。但有个问题始终悬而未决:当参数竞赛撞上物理定律,这种低成本奇迹还能持续多久?(这个问题你怎么看?欢迎在评论区battle~)