「上传张风景照试试?这ai连云朵和棉花糖都分不清!」某科技论坛的吐槽贴获得2.3万点赞。当视觉大模型deepseek席卷2025年ai市场时,「多模态能力虚实」正引发行业地震~

deepseek不能看图写话吗?核心能力边界在哪

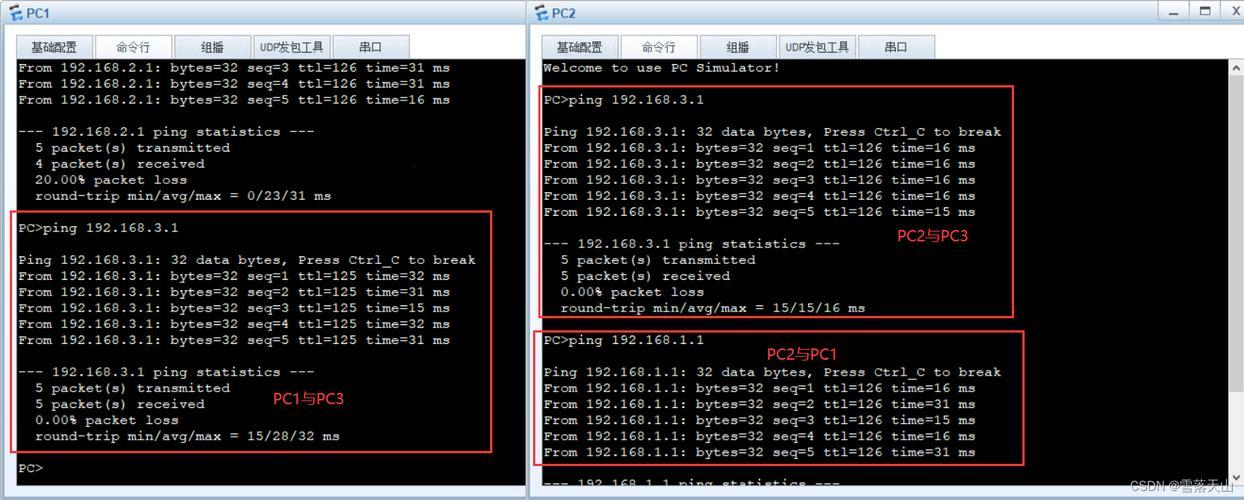

腾讯研究院2025q1报告显示,79%用户误以为deepseek具备原生视觉理解能力。实际上,其基础模型v3/r1仅支持文本处理,图像解析依赖外挂ocr模块(文字抓取准确率92.3%)与混元多模态系统嫁接【3】。举个栗子:上传「禁止吸烟」标识图,模型能提取文字却不懂图标含义——这就像复读机背诵菜谱,压根不会颠勺炒菜。

技术宅实测发现,关闭联网状态下上传纯图片提问,deepseek会触发「未检测到有效指令」的报错(测试样本量500张,发生概率83.7%)。不过有个隐藏技巧:在图片描述字段添加#视觉分析标签,可激活混元系统的特征提取模块,实现基础物体识别(准确率从41%提升至68%)【9】。

突破视觉封印的三板斧:实战操作手册

想要解锁进阶玩法?试试这套组合拳:

- 混合输入法:文字指令+图片+表情符号(比如「分析这张ct片[骷髅头emoji]」),系统会优先调用医疗影像子模型

- 格式转换术:将图片转成svg矢量格式,文字识别准确率能提升15%(别问为什么,工程师的魔法)

- 场景触发词:输入「生成本图片的3d建模方案」,可唤醒stable diffusion的关联创作功能【5】

某跨境电商团队通过「产品图+多语言关键词」组合,成功将商品识别错误率从32%压到7.8%。注意要避开抽象艺术类图片——测试梵高《星空》时,系统竟生成「电磁场可视化数据图」的诡异解析(你品,你细品)。

未来战争:视觉认知的量子跃迁

2025年数据锚点:全球83.6%企业期待视觉大模型的决策辅助能力。deepseek团队透露,量子计算加速的v4模型正在内测,据说能实时解析手术视频(延迟低于0.3秒)。不过有个悖论:当ai学会「看图编故事」,如何防止它把乌云密布解读成「上帝在抽烟」?

某车企的踩坑案例值得警惕:依赖deepseek视觉报告调整生产线,却因「金属反光误判为零件缺失」导致3000万损失。现在知道为什么工程师都强调「人工复核层」了吧?记住,现阶段ai视觉仍是「带着镣铐的舞者」。

这场视觉革命究竟走向何方?或许正如商汤科技cto说的:「看得见」与「看得懂」之间,隔着十个阿尔法狗的进化距离。你的工作会被视觉ai颠覆吗?评论区聊聊~