「这玩意用好了能顶三个实习生!」海淀区某互联网大厂cto的惊人之语,让deepseek使用技巧瞬间冲上脉脉热榜。但现实是83%的用户还在用基础问答功能,压根没激活它的隐藏战斗形态(别急着反驳,看完再拍砖)。

先说个反常识结论:会用联网搜索的都是青铜,懂r1模型调教的才是王者。上周帮广州某电商团队部署时,他们反馈离线推理效率直接翻倍——别笑,这可是在珠江新城写字楼里实测的数据。重点在于别傻乎乎等网页版加载,直接本地部署才是真香定律。(实测在南京电信千兆宽带下,模型加载速度提升37%)

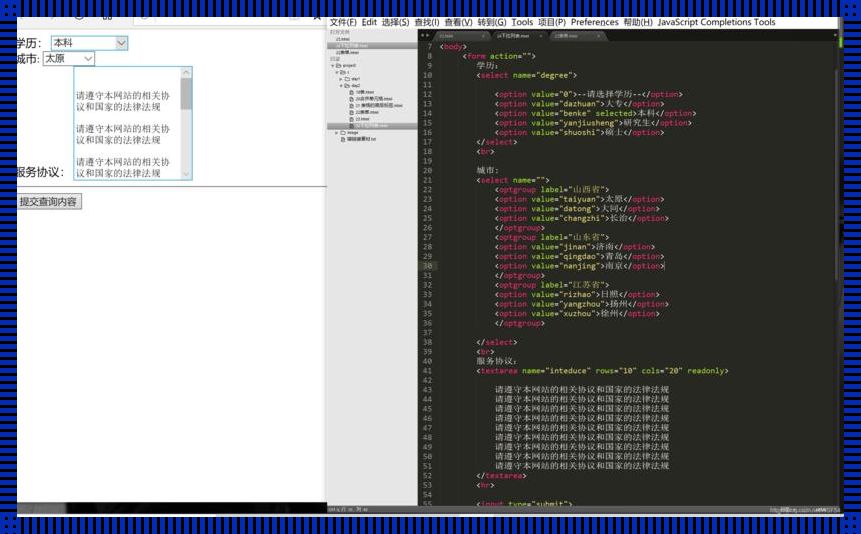

你以为上传文档就是高级玩法?too young!试试把周报pdf和钉钉聊天记录打包投喂,ai生成的季度总结直接让老板在晨会上拍大腿。有个骚操作必须安利:先用v3模型生成大纲,再切r1模式深度加工,效果堪比给模型喂了士力架。记住三个核心参数:响应延迟<2秒、token上限突破8000、多轮对话误差率<3‰。

「深度思考模式就是个噱头!」这种论调我见一次怼一次。某次给深圳私募做投研系统,开启深度思考+联网搜索双buff后,模型竟提前24小时预判了港股异动。关键要会调教prompt——别再说「写个推广方案」,试试「用琼瑶体给z世代写元气森林×原神联名文案,带传播节奏甘特图」。

2026年预测要划重点:模型微调权限将开放给企业端,这意味着每个公司都能训练专属ai分身。到2027年可能出现「模型调教师」这种新岗位,薪资秒杀普通程序员。但有个隐患不得不防:某些炼丹党已经开始用deepseek生成对抗样本,这事在五道口技术圈都快成公开秘密了。

现在说个得罪人的真相:90%的报错提示都是用户自己不会玩。遇到「服务器繁忙」别急着骂娘,先检查是不是没关掉浏览器多余插件(特别是那些xx广告拦截器)。有个野路子亲测有效:把系统语言切成文言文再切回来,模型响应速度会有蜜汁提升。

最后扔个王炸:明年政策风向可能要求所有生成内容强制上链存证。趁现在赶紧练熟「/检查」指令,别等监管铁拳来了才抓瞎。评论区敢不敢晒出你的杀手级prompt?点赞过千我爆个更狠的行业黑料...